Videoanalyse - Ein neuartiger Ansatz

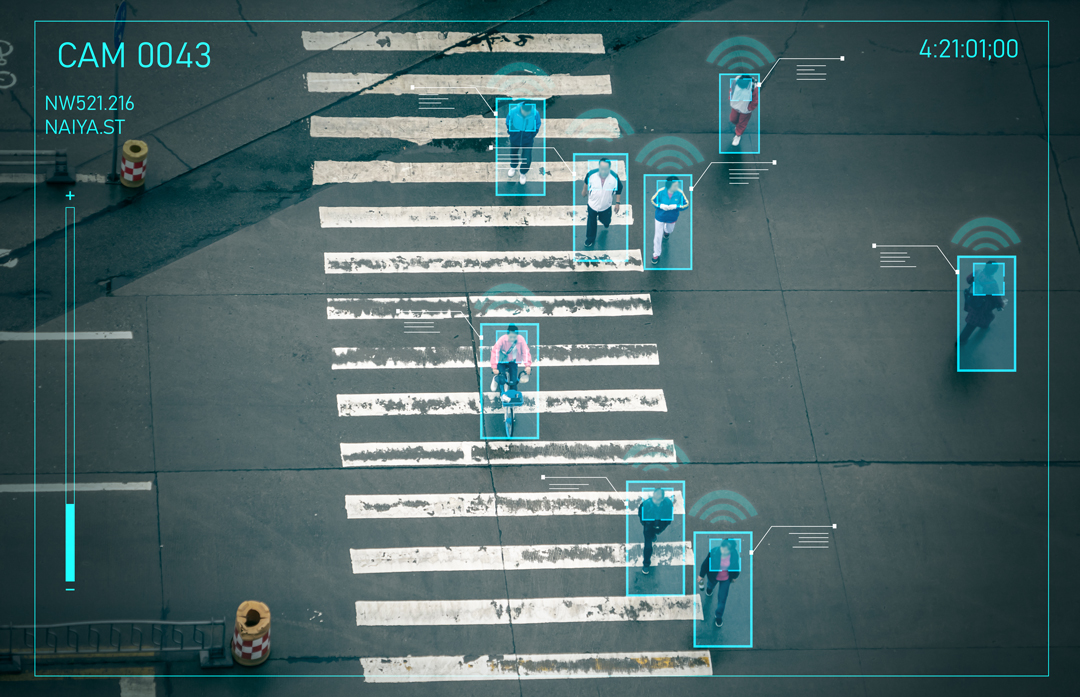

Stellen Sie sich eine Welt vor, in der Kameras nicht nur sehen, sondern verstehen. Eine Welt, in der jede Sekunde eines Videos nicht nur erfasst, sondern analysiert und interpretiert wird. Dies ist das Reich der Videoanalyse, ein Gebiet, das wir mit Faszination erforschen. Von der Identifizierung einer einfachen Handgeste bis hin zur komplexen Erkennung von Aktionen in Echtzeit, ist die Videoanalyse der Schlüssel zu einem tieferen Verständnis unserer visuell dominierten Welt.

Das Feld der Videoanalyse umfasst eine breite Palette von Herausforderungen und Aufgaben. Es kann die relativ einfache Aufgabe der Aktionsklassifizierung beinhalten, bei der ein Modell die in einem gegebenen Video dargestellte Aktivität ableitet. Andere, komplexere Aufgaben umfassen die zeitliche Aktionsdetektion, die darauf abzielt, die Zeitstempel bestimmter Aktionen vorherzusagen, und die räumliche Aktionsdetektion, die sich darauf konzentriert, alle Aktionen innerhalb des Videos zu lokalisieren und mit Begrenzungsrahmen zu markieren. Die Videoanalyse ist mehr als ein wissenschaftliches Unterfangen; sie dient mehreren realen Zwecken. Zum Beispiel kann sie in kassenlosen Geschäften verwendet werden, wo Kunden einfach nehmen können, was sie benötigen, und dann den Laden verlassen, da die Bezahlung für die Produkte automatisch erfolgt. Eine weitere Anwendung ist die automatische Kennzeichenerkennung, die als Ersatz für Standardtickets auf Parkplätzen verwendet werden kann; dadurch kann der Gesamtprozess beschleunigt werden.

Jede der genannten Aufgaben stellt eine andere Herausforderung dar und hebt die Weite des Themas hervor. Diese Vielfalt zeigt ihr Potenzial, einer breiten Palette von Zwecken zu dienen. In diesem Artikel werden wir uns hauptsächlich mit Aktionsklassifizierung, zeitlicher Aktionsdetektion und räumlicher Aktionsdetektion als Ganzes befassen, wenn wir über Videoanalyse sprechen. Dieser Schwerpunkt wird uns helfen, tiefer in die Feinheiten und Anwendungen dieser Technologien in der sich ausweitenden Welt der Videoanalyse einzutauchen.

Neuartiger Ansatz in der Videoanalyse

Nachdem wir die Einleitung abgeschlossen haben, kommen wir nun zum Hauptthema unserer Diskussion. Wir möchten Ihnen einen neuartigen Ansatz in der Videoanalyse vorstellen, der anderen erfolgreichen Ansätzen in verschiedenen Bereichen der Deep-Learning-Landschaft ähnelt. Dies beinhaltet ein grundlegendes, selbstüberwachtes Modell, das leicht für zahlreiche nachgelagerte Aufgaben angepasst werden kann. VideoMAE v2 heißt dieses Modell, das zu den ersten im Segment der Videoanalyse von KI gehört, das eine ähnliche Rolle anstrebt, wie die GPT-Modellfamilie im Bereich der Verarbeitung natürlicher Sprache (Natural Language Processing, NLP).

Bevor wir in eine tiefere Analyse eintauchen, definieren wir, was wir unter einem „grundlegenden“ und „selbstüberwachten“ Modell verstehen:

Grundlegendes Modell: Dieser Begriff bezieht sich auf Modelle, die in einem gegebenen Bereich mehrere Zwecke erfüllen können, ohne größere Änderungen oder bedeutendes zusätzliches Training. Diese Modelle werden oft mit riesigen Datenmengen trainiert und erzielen in vielen Teilbereichen Ergebnisse auf dem neuesten Stand der Technik, vergleichbar mit spezialisierteren Modellen, die für einzelne Zwecke konzipiert wurden. Ein Beispiel ist das ChatGPT-Modell im Bereich NLP, das sowohl Übersetzung als auch Sentimentanalyse durchführen kann, ohne speziell für eine dieser Aufgaben trainiert zu sein.

Selbstüberwachtes Modell: Dies bezieht sich auf Modelle, die keine etikettierten Daten für das Training benötigen. Stattdessen lernt das Modell die allgemeinen Merkmale der präsentierten Daten. Dieser Ansatz verringert die Last, enorme Mengen an etikettierten Daten zu sammeln, und spart somit Zeit und Geld. Er kann sehr gute Ergebnisse liefern, da das Sammeln von unetikettierten Daten viel einfacher ist und daher in großer Menge gesammelt werden kann.

Eine Modellbeschreibung

Lassen Sie uns nun in die Funktionsweise des Modells eintauchen und verstehen, wie es seine Spitzenleistung erreicht. Zunächst durchläuft das Modell ein selbstüberwachtes Vortraining, bei dem es eine umfangreiche Sammlung von unbeschrifteten Videoclips aus verschiedenen Quellen nutzt, um allgemeine Videorepräsentationen zu erlernen. Diese Quellen umfassen YouTube und Instagram sowie bekannte öffentliche Datensätze für Videoanalyse wie die Kinetics- und Something-Something-Datensätze. Die Größe und Vielfalt der gesammelten Daten sind im Videobereich beispiellos, mit etwa 1,35 Millionen Videoclips aus sehr unterschiedlichen Quellen.

Der Vortrainingsprozess zielt darauf ab, die allgemeinen Merkmale der vorliegenden Daten zu erlernen. Zu diesem Zweck verwenden die Autoren die Methode des Masked Auto Encoding in einer Videoeinrichtung (daher das MAE in VideoMAE). Diese Methode beinhaltet zunächst die Kodierung des Videos mit einem Vision Transformer (ViT) Rückgrat, während ein sehr hohes Maskierungsverhältnis von 90% – 95% verwendet wird. Das bedeutet, dass die Mehrheit der Pixel dem Modell nicht sichtbar ist, was eine bedeutungsvollere und herausforderndere Aufgabe darstellt. Nach dem Kodierungsprozess versucht der Decoder-Teil des Netzwerks, das Video basierend auf dem Ausgang des Encoders zu rekonstruieren. Die Leistung des Netzwerks wird durch den Mean Squared Error (MSE)-Verlust zwischen den normalisierten maskierten Pixeln und den rekonstruierten Pixeln gemessen. Im Wesentlichen strebt das Netzwerk danach, ein kodiertes Video so genau wie möglich wiederzugeben.

Nach dem Vortraining schlagen die Autoren vor, dass zur Entfaltung des vollen Potenzials des Modells und um ein Überanpassen an einen spezifischen Datensatz während des Feintunings zu vermeiden, ein nach dem Vortraining überwachtes Feintuning durchgeführt werden sollte. In dieser Phase werden die Semantiken verschiedener Datensätze in das vortrainierte Modell integriert. Sowohl die Phase nach dem Vortraining als auch das eigentliche Feintuning an einem spezifischen Datensatz verwenden nur den Encoder-Teil des Netzwerks, das ViT-Rückgrat, ohne den Decoder.

Schließlich, sobald die Vortrainings- und Nach-Vortrainingsphasen abgeschlossen sind, können wir das Modell auf den von uns gewählten Datensatz feintunen. Dank der vorherigen Prozesse benötigt das Modell jetzt nur noch geringfügige Anpassungen der Netzwerkgewichte, da es bereits die allgemeinen Merkmale, die in den Videodaten vorhanden sind, und die spezifischeren Semantiken der Aufgabe aus der Nach-Vortrainingsphase gelernt hat. Dieser Ansatz ermöglicht es dem Modell, über verschiedene Benchmarks hinweg Spitzenleistungen zu erbringen, mit minimalem zusätzlichen Feintuning an einem spezifischen Datensatz.

Die wichtigsten Erkenntnisse der Videoanalyse

Wie wir hervorgehoben haben, umfasst der Bereich der Videoanalyse eine breite Palette von Herausforderungen und Aufgaben. Ursprünglich blieb dieses Feld hinter den Gebieten der Verarbeitung natürlicher Sprache (NLP) und der Bildanalyse zurück, vor allem weil es eine große Menge an Daten erforderte, die schwerer zu beschaffen waren, und der gesamte Trainingsprozess im Vergleich zum Bildbereich komplexer war. Mit dem Aufkommen von neuartigen Ansätzen, wie durch VideoMAE v2 exemplarisch gezeigt, und der Erweiterung von Datensätzen, entwickelt sich das Feld jedoch schnell weiter. Die Ergebnisse werden mit jedem neuen Modell immer vielversprechender und signalisieren einen bedeutenden Fortschritt in den Fähigkeiten der Videoanalyse.

Nutzen Sie fortschrittliche Videoanalytik durch maßgeschneiderte AI-Lösungen von theBlue.ai

Bei theBlue.ai integrieren wir unsere tiefgehende KI-Expertise nahtlos in die Entwicklung fortschrittlicher Lösungen für die Videoanalyse. Wir sind spezialisiert darauf, maßgeschneiderte, auf KI basierende Videoanalyse-Systeme zu entwickeln, die präzise auf Ihre Projekte und Geschäftsziele abgestimmt sind. Kontaktieren Sie uns für eine effektive und zielorientierte Transformation Ihrer Ideen in praktische Anwendungen.